扩散模型(Diffusion Model)是一类通过逐步添加噪声再逆向去噪来生成内容的生成式AI技术。

核心要点

- 一句话定义:扩散模型通过噪声扩散与逆向去噪实现高质量内容生成。

- 核心特点:基于概率扩散过程,训练稳定且可控性强。

- 实际应用场景:AI图像生成、音频合成、分子设计等。

- 与传统对比:相较于GAN,扩散模型更易收敛、模式坍缩风险低。

- 风险提示:算力成本高、版权与伦理争议仍待解决。

什么是扩散模型(Diffusion Model)?

扩散模型是一种让机器通过噪声逐步学习、再逆向还原的生成方法。

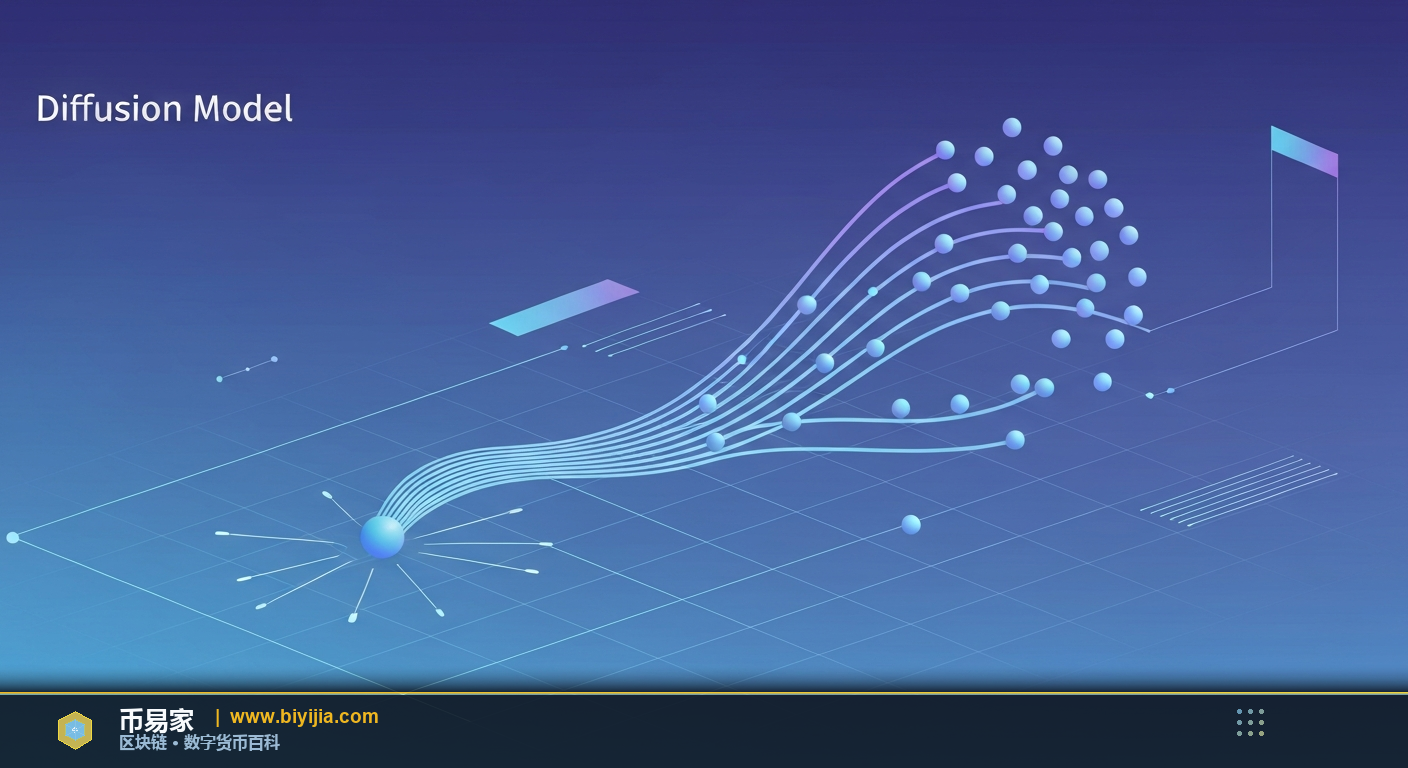

技术上,它先把真实数据加上层层随机噪声,形成一个“噪声池”。模型在训练时学会预测每一步噪声的方向,逆过程里把噪声一步步抹去,最终恢复出新内容。通俗点说,就是让模型先把画布弄得一团乱,然后教它怎么把乱画恢复成一幅完整的画。

想象你在玩拼图:先把完整的图拆成碎片(加噪声),然后再按照记忆一点点拼回去(逆向去噪),拼出来的图可能是全新的风景。

运作原理

- 正向扩散:从真实数据出发,按预设步数逐步加入高斯噪声,直至接近纯噪声。

- 噪声预测:模型在每一步学习预测加入的噪声分量。

- 逆向去噪:推理时从纯噪声开始,利用模型的噪声预测逆向迭代,逐步恢复数据。

- 采样策略:常用DDPM、DDIM等采样方法控制速度与质量的平衡。

核心特点

- 逐步生成:通过多步迭代实现细粒度控制。

- 训练稳定:损失函数简单,收敛过程相对平滑。

- 多模态兼容:同一框架可用于图像、音频、文本等多种数据。

- 可调采样:步数可增可减,兼顾速度与质量。

- 抗模式坍缩:不像GAN容易只生成少数几种模式。

- 高保真度:在大模型下可生成接近真实的细节。

实际应用场景

- Stable Diffusion:开源图像生成模型,月活用户超200万,日均生成图片超过500万张。

- DALL·E:OpenAI推出的文本到图像系统,2025年商业版月收入突破1亿美元。

- Midjourney:社区驱动的艺术创作平台,2026年累计创作作品超过1500万幅。

- 音频扩散模型:如AudioLDM,可生成高保真音乐片段,已被多家音乐版权公司用于快速原型。

- 药物分子设计:AlphaFold的扩散版在2025年帮助发现30余种潜在新药分子。

与相关概念对比

- 扩散模型 vs GAN:GAN依赖对抗训练,容易出现模式坍缩;扩散模型通过噪声过程,训练更稳,生成多样性更好。

- 扩散模型 vs VAE:VAE在重建误差上有局限,生成质量一般;扩散模型在高分辨率图像上表现更佳。

- Stable Diffusion vs DALL·E:Stable Diffusion是开源且本地可跑,成本可控;DALL·E更依赖云端服务,使用门槛相对更高。

风险与注意事项

- 算力消耗:每次采样需要数百步,导致GPU成本高企,尤其在大模型上。

- 版权争议:模型训练数据往往包含受版权保护的图像,生成作品可能触及侵权。

- 伦理误用:AI图像生成容易被用于伪造、误导信息,需要监管与自律。

- 数据偏见:训练数据偏向某些风格或文化,生成结果可能缺乏多样性。

- 安全漏洞:模型可被对抗攻击诱导生成特定内容,需做好防护。

关键数据

2025年,Stable Diffusion的公开模型参数量突破20亿,社区贡献模型下载量已超过5千万次(来源:GitHub统计)。

根据2026年AI行业报告,扩散模型在图像生成质量评分上平均比GAN高出12%(来源:TechRadar AI评测)。

常见问题

扩散模型是什么?

它是一种通过逐步加入噪声再逆向去噪的方式,让机器生成图像、音频或文本等内容的AI技术。

Stable Diffusion和DALL·E有什么区别?

Stable Diffusion是开源、可本地运行的模型,适合自定义和低成本使用;DALL·E则是商业化云服务,提供更强的文本理解但使用成本相对更高。

扩散模型需要多少算力?

普通分辨率(512×512)下,使用80步的采样大约需要一块RTX 3080显卡 5-10 秒;高分辨率或更多步数会成倍增加耗时。

使用扩散模型会不会侵犯版权?

如果模型训练时使用了受版权保护的素材,生成的相似作品可能涉及侵权,实际风险取决于使用场景和当地法律。

我可以自己训练扩散模型吗?

可以,开源代码和预训练权重已经公开,只要有足够的显存(至少16GB)和数据,就能进行微调或从头训练。

总结

扩散模型(Diffusion Model)凭借其稳健的训练特性和高保真度,已经成为AI图像生成(AI图像生成)的主流技术之一。了解其原理、优势与潜在风险,能帮助你在2026年的AI浪潮中更安全、更高效地使用相关工具。